MiniMax-M1是什么?

MiniMax-M1是稀宇科技旗下品牌MiniMax推出的全球首款开源大规模混合架构推理模型。它拥有出色的长上下文处理能力和高效的推理性能,支持最多100万字的上下文输入和8万Token的输出。得益于闪电注意力机制的采用,MiniMax-M1极大地提升了计算资源的利用效率。在软件工程和长文本理解等复杂应用场景中,该模型表现出众,以其极高的性价比受到广泛关注。更为吸引的是,MiniMax-M1提供免费且不限量的使用权限,以及价格亲民的API服务,为用户带来了极大的便利和经济效益。

MiniMax-M1的技术优势

- 这项创新技术能够接收和处理高达100万字的上下文输入,其能力堪比Google Gemini 2.5 Pro,是DeepSeek R1处理能力的8倍。在推理输出方面,它更是提供了业内领先的8万Token长度。这一卓越性能主要归功于其独特的闪电注意力机制,这是一种以混合架构为主的技术,能够在处理长的上下文输入和复杂的深度推理时,展现出显著的高效性。例如,在进行8万Token的深度推理时,它仅需消耗DeepSeek R1约30%的计算资源。

- 此外,开发了一种更为高效的强化学习算法——CISPO。该算法通过优化重要性采样权重(而非传统的token更新方式),显著提升了强化学习的效率。在AIME实验中,CISPO的收敛速度比字节跳动近期提出的DAPO等强化学习算法快了一倍,明显优于DeepSeek早期使用的GRPO算法。整个强化学习阶段仅使用了512块H800显卡,在短短三周内就完成了训练,租赁成本仅为53.74万美元,相比预期节省了一个数量级的费用。

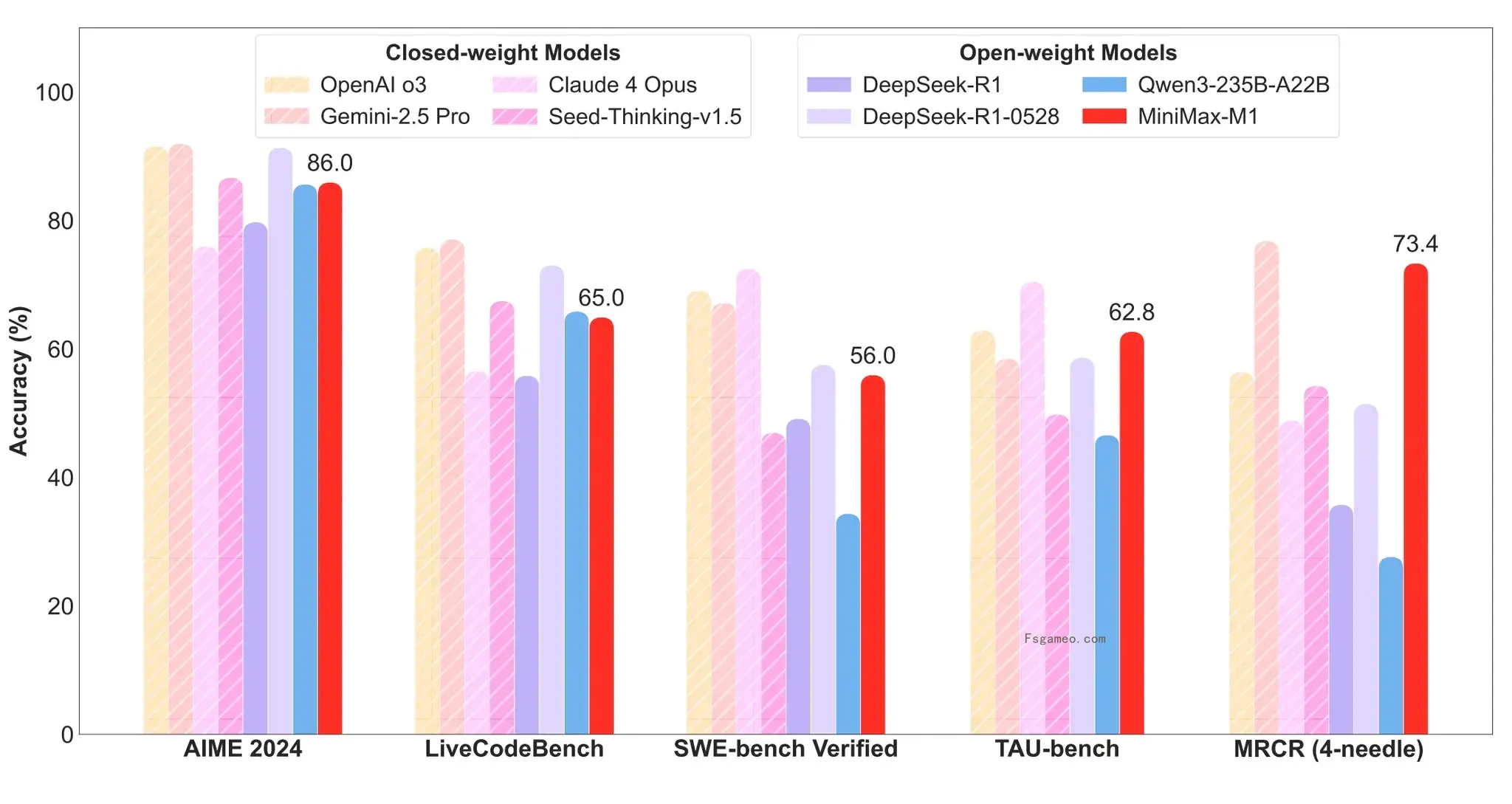

MiniMax-M1的性能表现

- 在软件工程的场景中,MiniMax-M1-40k和MiniMax-M1-80k在SWE-bench验证基准上分别取得了55.6%和56.0%的成绩,虽略低于DeepSeek-R1-0528的57.6%,但已显著超越其他开源权重模型。

- 在长上下文理解任务方面,得益于百万级上下文窗口的支持,M1系列的表现极为出色,全面超越了所有开源权重模型,甚至包括OpenAI o3和Claude 4 Opus,全球排名第二,仅以微弱差距落后于Gemini 2.5 Pro。

- 在代理工具的使用场景中,MiniMax-M1-40k在TAU-bench中领先所有开源权重模型,并成功击败Gemini-2.5 Pro。

- 而MiniMax-M1-80k在大多数基准测试中始终优于MiniMax-M1-40k,这一结果验证了扩展测试时增加计算资源的有效性。

如何使用MiniMax-M1?

1、普通用户

MiniMax-M1已经在MiniMax Web 和 APP 上都保持不限量免费使用。

2、企业和开发者

MiniMax开发者平台提供业内最低价格的 API 服务:

- 0-32k 输入长度:输入0.8元/百万 token,输出8元/百万 token。

- 32k-128k 输入长度:输入1.2元/百万 token,输出16元/百万 token。

- 128k-1M 输入长度:输入2.4元/百万 token,输出24元/百万 token。

前两种模式性价比高于 DeepSeek-R1,后一种模式 DeepSeek 模型不支持。

3、开源与部署

- 在线体验:https://chat.minimax.io/

- Hugging Face:https://huggingface.co/MiniMaxAI

- GitHub:https://github.com/MiniMax-AI/MiniMax-M1

- 技术报告:https://arxiv.org/abs/2506.13585